Chạy Gemma 4 trên Raspberry Pi 5: Khám phá tiềm năng AI trên thiết bị nhỏ gọn

Raspberry Pi 5, một thiết bị nhỏ gọn nhưng mạnh mẽ, đang mở ra những cánh cửa mới cho việc triển khai các mô hình trí tuệ nhân tạo ngay tại nhà. Bài viết này sẽ đi sâu vào cách cài đặt và vận hành mô hình ngôn ngữ lớn (LLM) Gemma 4 (phiên bản E2B nhỏ nhất) trên Raspberry Pi 5, đồng thời đánh giá hiệu suất thực tế của nó.

Giới thiệu về thử nghiệm

Mục tiêu của thử nghiệm là kiểm tra khả năng chạy mô hình Gemma 4 E2B trên Raspberry Pi 5. Gemma 4 E2B là phiên bản nhỏ nhất trong dòng Gemma 4, có kích thước khoảng 4.5 GB và khoảng 4 tỷ tham số, được phát hành dưới giấy phép Apache 2.0 cho phép sử dụng thương mại.

Điểm nổi bật của Gemma 4:

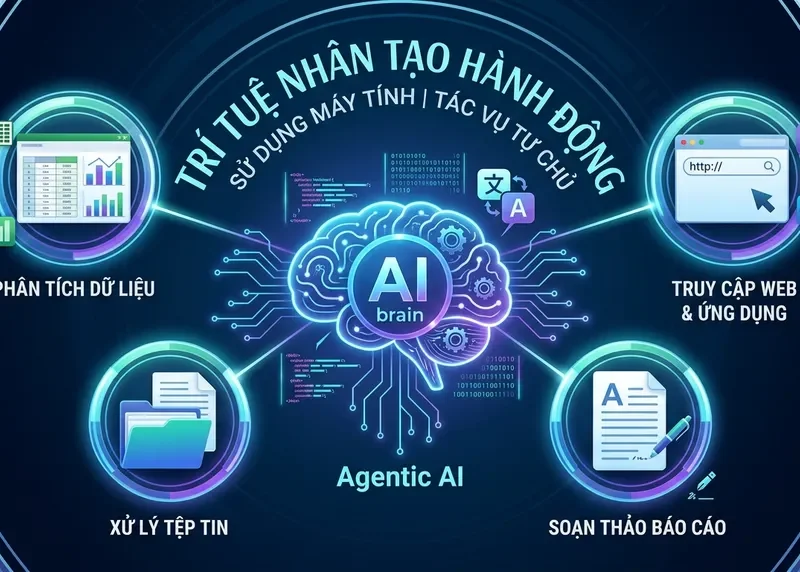

- Thiết kế cho quy trình làm việc dựa trên tác nhân: Hỗ trợ gọi hàm và làm việc với công cụ.

- Xử lý đa phương tiện: Có khả năng xử lý hình ảnh, video và các mô hình nhỏ hơn (bao gồm E2B) còn hỗ trợ âm thanh, có thể hiểu trực tiếp lời nói.

- Cửa sổ ngữ cảnh lớn: 128.000 token và hỗ trợ gần như tất cả các ngôn ngữ.

Thông số Raspberry Pi 5 sử dụng:

- CPU: 4 nhân

- RAM: 8 GB

Chuẩn bị Raspberry Pi 5

Để bắt đầu, Raspberry Pi 5 được cấu hình với Ubuntu Server và truy cập qua SSH. Không cần cài đặt giao diện đồ họa.

Lưu trữ mô hình trên SSD:

Raspberry Pi 5 hỗ trợ kết nối SSD một cách đơn giản. Việc lưu trữ các mô hình AI trên SSD thay vì thẻ SD sẽ cải thiện đáng kể tốc độ truy xuất và độ bền. Do đó, cần cấu hình để các mô hình tải xuống sẽ được lưu trữ trên SSD.

Cài đặt và cấu hình LM Studio CLI

LM Studio cung cấp một phiên bản dòng lệnh (CLI) tiện lợi, cho phép quản lý và chạy các mô hình LLM mà không cần giao diện đồ họa.

Các bước cài đặt LM Studio CLI:

- Cài đặt: Sử dụng script cài đặt đặc biệt do nhà phát triển LM Studio cung cấp. Script này sẽ tự động xử lý mọi thứ.

- Khởi động Daemon: Sau khi cài đặt, khởi động Daemon của LM Studio.

- Thay đổi vị trí lưu trữ mô hình: Cấu hình LM Studio để lưu trữ các mô hình đã tải xuống vào SSD đã kết nối thay vì thẻ SD.

Tải và tải mô hình Gemma 4 E2B

Sau khi LM Studio CLI được thiết lập, tiến hành tải mô hình Gemma 4 E2B.

Tải mô hình:

- Sử dụng lệnh của LM Studio để tải phiên bản E2B của Gemma 4. Mô hình này có kích thước khoảng 4.5 GB.

- Sau khi tải xong, tiến hành tải mô hình vào RAM của Raspberry Pi 5 để sẵn sàng sử dụng.

Khởi động máy chủ API và truy cập mạng nội bộ

LM Studio cho phép bạn khởi động một máy chủ API cục bộ để tương tác với mô hình. Ban đầu, máy chủ này chỉ có thể truy cập được trên chính Raspberry Pi.

Khởi động máy chủ API:

- Khởi động máy chủ API của LM Studio trên cổng 4000.

- Vấn đề: Máy chủ mặc định chỉ truy cập được từ

localhost. Để truy cập từ các máy tính khác trong mạng nội bộ, cần một giải pháp.

Giải pháp truy cập mạng nội bộ bằng `socat`:

Vì LM Studio CLI không cung cấp tham số để mở rộng quyền truy cập mạng cho máy chủ API, chúng ta sẽ sử dụng tiện ích socat của Linux để chuyển tiếp cổng.

- Cài đặt

socat(nếu chưa có):

bash sudo apt update sudo apt install socat

- Chuyển tiếp cổng: Chạy lệnh

socatđể chuyển tiếp các yêu cầu từ một cổng bên ngoài (ví dụ: 4001) đến cổng nội bộ của LM Studio (4000).

bash socat TCP-LISTEN:4001,fork TCP:localhost:4000

TCP-LISTEN:4001,fork: Lắng nghe các kết nối TCP trên cổng 4001.forkđảm bảo mỗi kết nối mới sẽ được xử lý trong một tiến trình riêng.TCP:localhost:4000: Chuyển tiếp các kết nối nhận được đếnlocalhosttrên cổng 4000, nơi máy chủ LM Studio đang chạy.- Lưu ý: Để lệnh này chạy liên tục ngay cả khi bạn ngắt kết nối SSH, hãy sử dụng các công cụ như

tmuxhoặcscreen.

Bây giờ, mọi yêu cầu gửi đến Raspberry Pi trên cổng 4001 sẽ được chuyển hướng nội bộ đến máy chủ LM Studio.

Tương tác với mô hình từ máy tính khác

Với máy chủ API đã được thiết lập và có thể truy cập qua mạng, bạn có thể tương tác với Gemma 4 từ bất kỳ máy tính nào trong cùng mạng nội bộ.

Tương thích API OpenAI:

Máy chủ cục bộ của LM Studio mô phỏng hoàn toàn API của OpenAI. Điều này có nghĩa là bất kỳ ứng dụng nào cho phép bạn chỉ định một điểm cuối (endpoint) hoặc URL cơ sở (base URL) tùy chỉnh của OpenAI đều có thể hoạt động với mô hình cục bộ của bạn.

Các ứng dụng hỗ trợ:

- Giao diện chat như Chatbox AI, Open Web UI.

- Các trình soạn thảo và IDE như VS Code, Cursor, Z editor.

Cấu hình trong ứng dụng:

Bạn cần cấu hình ứng dụng của mình để sử dụng URL API của Raspberry Pi (ví dụ: http://<Địa chỉ IP của Raspberry Pi>:4001) và chọn mô hình Gemma 4.

Đánh giá hiệu suất thực tế

Sau khi mọi thứ được thiết lập, đã đến lúc kiểm tra hiệu suất của Gemma 4 trên Raspberry Pi 5.

Thử nghiệm 1: Viết hàm Python sắp xếp danh sách đối tượng

- Tải CPU: Toàn bộ 4 nhân CPU của Raspberry Pi 5 được sử dụng đầy đủ trong quá trình suy luận.

- Tốc độ tạo phản hồi: Chấp nhận được cho các tương tác đơn giản hoặc các script mà thời gian phản hồi không quá quan trọng.

- Tổng thời gian: Khoảng 6 phút (bao gồm cả giai đoạn suy luận và tạo phản hồi). Mô hình đã cung cấp hai triển khai khác nhau của hàm sắp xếp và giải thích cách sử dụng từng loại.

Thử nghiệm 2: Đề xuất 3 ý tưởng ứng dụng web

- Tốc độ tạo phản hồi: Tương tự như tác vụ lập trình, tốc độ này vừa đủ thoải mái để một người đọc trong thời gian thực, nhưng vẫn có thể chấp nhận được cho các kịch bản không tương tác.

- Tổng thời gian: Khoảng 5 phút. Mô hình đã tạo ra rất nhiều văn bản và mô tả chi tiết từng ý tưởng.

Kết luận và ứng dụng

Thử nghiệm đã chứng minh rằng việc chạy Gemma 4 (phiên bản E2B) trên Raspberry Pi 5 là hoàn toàn khả thi và mang lại kết quả có thể sử dụng được.

Điểm mấu chốt:

- Gemma 4 E2B có thể chạy thành công trên Raspberry Pi 5.

- Có thể tương tác với mô hình từ các máy tính khác qua mạng nội bộ.

- Hiệu suất, mặc dù không nhanh chóng mặt, nhưng chấp nhận được cho một số tác vụ nhất định.

Ứng dụng tiềm năng:

Thiết lập này rất phù hợp cho các script tự động hóa, các dự án AI nhỏ gọn, hoặc các tác vụ không đòi hỏi phản hồi tức thì, nơi mà việc có một mô hình LLM cục bộ, tiết kiệm năng lượng là một lợi thế. Nó mở ra khả năng triển khai các ứng dụng AI phân tán và độc lập mà không cần phụ thuộc vào dịch vụ đám mây.