Amazon Bedrock AgentCore: Định hình lại tương lai AI Agent doanh nghiệp?

Tóm tắt nội dung chính

- Amazon Web Services (AWS) đã gây tiếng vang lớn tại Hội nghị thượng đỉnh New York: liên tục nhắc đến khái niệm “AI Agent” và công bố Amazon Bedrock AgentCore, khẳng định tầm nhìn chiến lược và mở ra kỷ nguyên mới cho việc triển khai tác nhân AI.

- Khái niệm AI Agent đang nhanh chóng trở thành tâm điểm của ngành công nghệ: thể hiện qua tần suất từ khóa “Agent” xuất hiện tới 217 lần tại sự kiện AWS, phản ánh xu hướng phát triển từ các mô hình nền tảng đơn lẻ đến những hệ thống tác nhân có khả năng tự chủ, phối hợp.

- Thị trường AI Agent đang chứng kiến sự tăng trưởng mạnh mẽ: hơn 50% công ty đã triển khai các tác nhân AI trong môi trường sản xuất và gần 80% đang trong quá trình phát triển, với Gartner dự báo 33% phần mềm doanh nghiệp sẽ tích hợp AI Agent vào năm 2028.

- Amazon Bedrock AgentCore được giới thiệu như một giải pháp “dọn vào ở ngay” cho AI Agent doanh nghiệp: nhằm đơn giản hóa và tối ưu hóa toàn bộ quá trình phát triển, từ tích hợp mô hình ngôn ngữ lớn (LLM), kết nối cơ sở dữ liệu đến gọi API và xây dựng khả năng ra quyết định.

- AgentCore bao gồm 7 dịch vụ cốt lõi được tối ưu hóa: bao gồm AgentCore Runtime (môi trường không máy chủ), AgentCore Memory (quản lý bộ nhớ), AgentCore Observability (giám sát), AgentCore Identity (truy cập an toàn), AgentCore Gateway (chuyển đổi API), AgentCore Browser (tự động hóa web) và AgentCore Code Interpreter (chạy mã biệt lập).

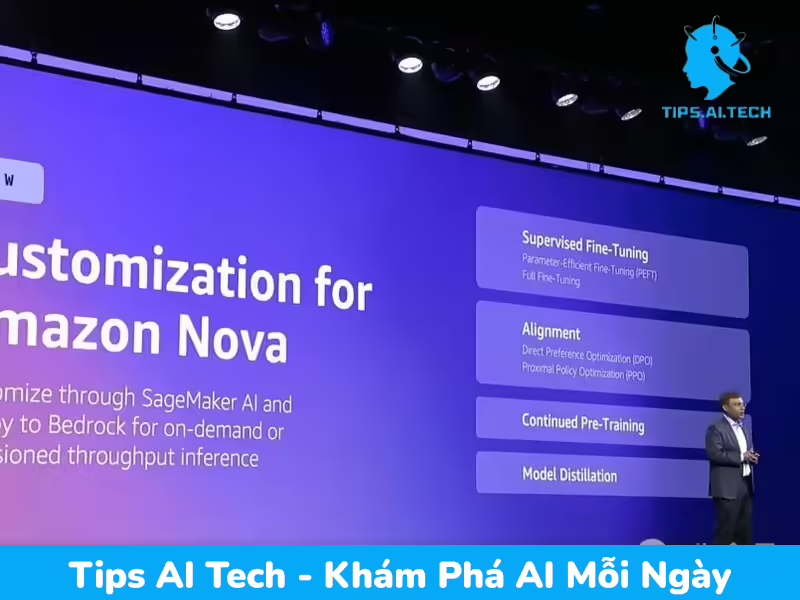

- AWS cũng giới thiệu các cải tiến để tăng cường độ tin cậy và ứng dụng của AI Agent: như AI Agents và Tools trong Marketplace để dễ dàng tìm kiếm giải pháp, khả năng tùy chỉnh cho mô hình Amazon Nova trong Amazon SageMaker AI, và Amazon Nova Act cho phép AI Agent thực hiện nhiệm vụ trực tiếp trong trình duyệt web.

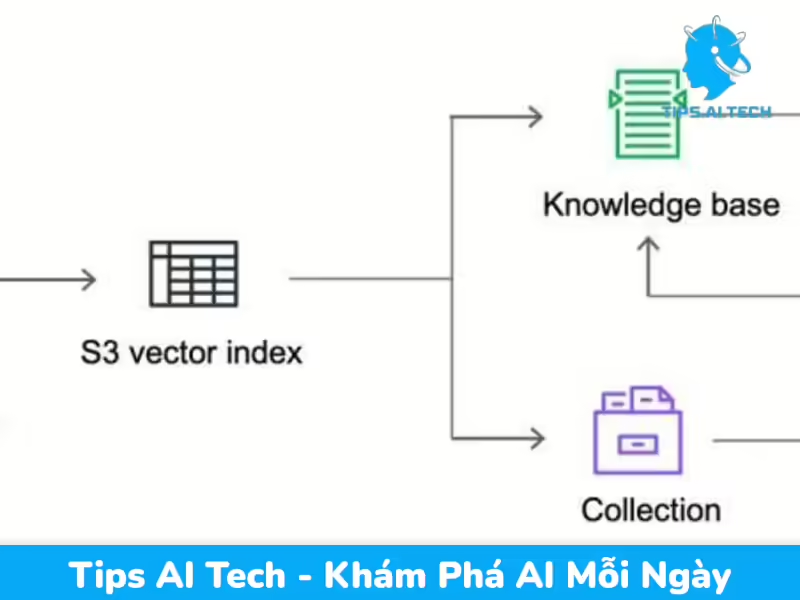

- Amazon S3 Vectors được ra mắt để giải quyết thách thức về quản lý dữ liệu vector quy mô lớn: đây là dịch vụ lưu trữ đối tượng đám mây đầu tiên hỗ trợ lưu trữ dữ liệu vector với hiệu suất truy vấn dưới giây và khả năng giảm tổng chi phí lên đến 90%, tích hợp với Amazon Bedrock Knowledge Bases và OpenSearch Service.

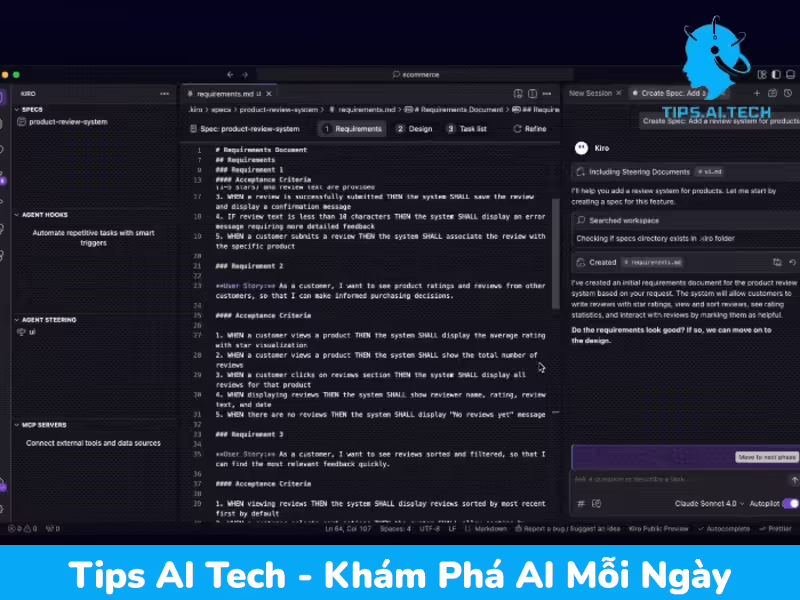

- Kiro, một công cụ lập trình AI miễn phí hoàn toàn mới, được giới thiệu để thay đổi cách lập trình: nó giúp biến ý tưởng thành phần mềm thực tế bằng cách sử dụng các tác nhân AI chuyên nghiệp từ khởi tạo dự án, thiết kế, lập trình đến bảo trì, và tiêu chuẩn hóa quy trình làm việc của lập trình AI.

- Sự tập trung toàn diện vào AI Agent là “nước cờ lớn” của AWS: nhằm trở thành nơi tốt nhất để xây dựng các AI Agent hữu ích nhất thế giới, giúp doanh nghiệp nâng cao hiệu quả hoạt động và phản ánh xu hướng thị trường ưu tiên các chức năng AI Agentic đa mô hình.

Tại Hội nghị thượng đỉnh New York vừa qua, Amazon Web Services (AWS) đã gây tiếng vang lớn khi liên tục nhắc đến khái niệm “AI Agent” và công bố Amazon Bedrock AgentCore. Động thái này không chỉ khẳng định tầm nhìn chiến lược của “ông lớn” điện toán đám mây mà còn mở ra một kỷ nguyên mới cho việc triển khai các tác nhân AI trong môi trường sản xuất, hứa hẹn biến những ứng dụng AI phức tạp trở nên dễ dàng tiếp cận và quản lý hơn bao giờ hết.

Bối cảnh & Tầm quan trọng của AI Agent?

Khái niệm AI Agent không chỉ là một từ khóa công nghệ mà là một xu hướng phát triển tất yếu, chuyển dịch từ các mô hình AI đơn lẻ sang những hệ thống có khả năng tự chủ, phối hợp. Doanh nghiệp cần chủ động nghiên cứu và chuẩn bị để tận dụng lợi thế này.

Trong bối cảnh ngành công nghệ đang chứng kiến sự bùng nổ của trí tuệ nhân tạo tạo sinh, khái niệm AI Agent (tác nhân AI) đang nhanh chóng trở thành tâm điểm. Tại sự kiện của AWS, tần suất xuất hiện của từ khóa “Agent” lên tới 217 lần, trung bình cứ hơn 20 giây lại được nhắc đến một lần. Điều này không chỉ thể hiện sự tập trung tuyệt đối của AWS mà còn phản ánh xu hướng phát triển tất yếu của AI: từ các mô hình nền tảng đơn lẻ đến những hệ thống tác nhân có khả năng tự chủ, phối hợp để hoàn thành các nhiệm vụ phức tạp.

Theo các khảo sát gần đây từ LangChain, hơn 50% công ty đã triển khai các tác nhân AI trong môi trường sản xuất và gần 80% đang trong quá trình phát triển. Gartner thậm chí dự báo rằng đến năm 2028, 33% phần mềm doanh nghiệp sẽ tích hợp AI Agent (so với chưa đầy 1% vào năm 2024), và 15% quyết định công việc hàng ngày sẽ do AI Agent tự chủ thực hiện. Các lĩnh vực như phát triển phần mềm, dịch vụ khách hàng, xử lý yêu cầu bồi thường và tự động hóa quy trình CNTT đang là những ứng dụng tiên phong. Phó chủ tịch AI Agentic của AWS, Swami Sivasubramanian, nhấn mạnh tầm nhìn: “Tương lai nằm ở việc tất cả các Agents và công cụ cùng hoạt động phối hợp.” Động thái này của AWS cho thấy một sự chuyển dịch chiến lược, từ việc cung cấp hạ tầng và mô hình cơ bản sang việc xây dựng một hệ sinh thái toàn diện, nơi các tác nhân AI có thể phát triển và hoạt động hiệu quả.

Amazon Bedrock AgentCore: Giải pháp "Dọn vào ở ngay" cho AI Agent doanh nghiệp?

Khi phát triển AI Agent, hãy tìm kiếm các giải pháp tích hợp toàn diện. Amazon Bedrock AgentCore là một ví dụ điển hình, cung cấp “bộ công cụ xây dựng tác nhân thông minh” giúp đơn giản hóa quá trình từ tích hợp mô hình ngôn ngữ lớn đến kết nối cơ sở dữ liệu và gọi API, tiết kiệm đáng kể công sức phát triển.

Nếu việc phát triển và triển khai một AI Agent vào môi trường sản xuất trước đây giống như nhận một “căn nhà thô”, đầy rẫy những vấn đề cần giải quyết từ việc tích hợp mô hình ngôn ngữ lớn (LLM), kết nối cơ sở dữ liệu, gọi API, đến việc xây dựng khả năng ra quyết định thông minh, thì Amazon Bedrock AgentCore chính là giải pháp “dọn vào ở ngay”.

AgentCore là một bộ công cụ xây dựng AI Agent cấp doanh nghiệp, được thiết kế để đơn giản hóa và tối ưu hóa toàn bộ quá trình. Trong khi Amazon Bedrock trước đây tập trung vào việc cung cấp quyền truy cập vào các mô hình nền tảng (như Claude, Meta, Nova, Mistral) – tương tự như việc “thuê bộ não” – thì AgentCore bổ sung một “bộ công cụ xây dựng tác nhân thông minh”, cho phép doanh nghiệp kết hợp các “bộ não” này để hoàn thành các nhiệm vụ cụ thể.

Bộ công cụ này bao gồm 7 dịch vụ cốt lõi, được tối ưu hóa để hoạt động liền mạch cùng nhau, giải quyết mọi chi tiết nhỏ trong quá trình triển khai AI Agent:

- AgentCore Runtime: Cung cấp môi trường không máy chủ, độ trễ thấp, hỗ trợ cách ly phiên làm việc và tương thích với mọi khung tác nhân (bao gồm cả mã nguồn mở). Nó cho phép xử lý các tác vụ đa phương thức và tác nhân chạy dài hạn. Chỉ với vài dòng mã, nhà phát triển có thể triển khai tác nhân lên đám mây.

- AgentCore Memory: Quản lý bộ nhớ phiên và bộ nhớ dài hạn, cung cấp thông tin ngữ cảnh cho mô hình, giúp tác nhân học hỏi từ các tương tác trong quá khứ. Nó hỗ trợ cả bộ nhớ ngắn hạn (lưu trữ tương tác) và bộ nhớ dài hạn với các chiến lược ghi nhớ ngữ nghĩa (ưu tiên người dùng, tóm tắt, thu thập dữ kiện), dữ liệu được mã hóa và phân chia theo không gian tên.

- AgentCore Observability: Cung cấp khả năng hiển thị từng bước quá trình thực thi của tác nhân, bao gồm gắn thẻ siêu dữ liệu, chấm điểm tùy chỉnh, kiểm tra quỹ đạo và bộ lọc gỡ lỗi/khắc phục sự cố. Nó giúp nhà phát triển gỡ lỗi, kiểm toán và giám sát hiệu suất tác nhân, với các bảng điều khiển tích hợp để theo dõi các chỉ số hoạt động chính (số phiên, độ trễ, tỷ lệ lỗi) và hỗ trợ OpenTelemetry.

- AgentCore Identity: Cho phép AI Agent truy cập an toàn vào các dịch vụ của AWS và công cụ của bên thứ ba (như GitHub, Salesforce, Slack) dựa trên danh tính người dùng hoặc sự đồng ý đã được ủy quyền trước. Nó tạo danh tính khối lượng công việc và nhà cung cấp thông tin xác thực (OAuth2, khóa API) để tác nhân truy cập tài nguyên an toàn.

- AgentCore Gateway: Chuyển đổi các API và hàm Lambda hiện có thành các công cụ có thể sử dụng cho tác nhân, cung cấp quyền truy cập thống nhất và khám phá thời gian chạy trên các giao thức (bao gồm MCP), đồng thời cung cấp mô hình xác thực kép để đảm bảo an toàn.

- AgentCore Browser: Cung cấp các phiên trình duyệt web được quản lý, mở rộng quy trình làm việc tự động hóa web của tác nhân. Nó có thể được sử dụng để truy cập các hệ thống không có API lập trình hoặc tài nguyên cần truy cập qua giao diện web.

- AgentCore Code Interpreter: Cung cấp môi trường biệt lập để chạy mã do tác nhân tạo ra. Nó được sử dụng để thực hiện các nhiệm vụ cần tính toán, chẳng hạn như tính toán mà tác nhân hỗ trợ khách hàng cần thực hiện.

AgentCore là nền tảng chạy tác nhân AI không máy chủ cấp doanh nghiệp đầu tiên cung cấp sự linh hoạt phát triển hoàn chỉnh, hỗ trợ mọi khung, mô hình và giao thức, với khả năng hỗ trợ khối lượng công việc 8 giờ, ranh giới bảo mật nghiêm ngặt và kiến trúc dịch vụ có thể kết hợp theo nhu cầu. Động thái này cho thấy AWS đang giải quyết trực tiếp những thách thức lớn nhất trong việc đưa AI Agent từ giai đoạn thử nghiệm sang sản xuất, đặc biệt là về khả năng mở rộng, bảo mật và quản lý phức tạp.

Không chỉ tiện lợi, còn phải đáng tin cậy: Các đổi mới hỗ trợ AI Agent?

Khả năng quản lý bộ nhớ và quan sát (observability) là cực kỳ quan trọng đối với AI Agent. AgentCore Memory giúp tác nhân học hỏi từ tương tác trong quá khứ, trong khi AgentCore Observability cung cấp khả năng hiển thị từng bước thực thi, giúp gỡ lỗi và giám sát hiệu suất hiệu quả.

Để tăng cường hơn nữa khả năng triển khai AI Agent, AWS không chỉ tập trung vào sự tiện lợi mà còn đặc biệt chú trọng đến độ tin cậy và khả năng ứng dụng thực tế.

Dựa trên AgentCore, AWS đã ra mắt AI Agents và Tools trong Marketplace, cho phép khách hàng dễ dàng tìm kiếm các giải pháp liên quan bằng ngôn ngữ tự nhiên, chỉ cần mô tả kịch bản sử dụng (hiện có hàng trăm giải pháp).

Bên cạnh đó, AWS còn giới thiệu các tính năng tùy chỉnh cho mô hình Amazon Nova trong Amazon SageMaker AI. Khách hàng giờ đây có thể tùy chỉnh Nova Micro, Nova Lite và Nova Pro trong suốt vòng đời huấn luyện mô hình, bao gồm tiền huấn luyện, tinh chỉnh có giám sát và căn chỉnh.

Một điểm đáng chú ý khác là sự ra đời của Amazon Nova Act, nhằm phá vỡ giới hạn mà nhiều AI Agent gặp phải khi quá phụ thuộc vào API. Nova Act cho phép tạo ra các AI Agent có khả năng thực hiện nhiệm vụ trực tiếp trong trình duyệt web. AWS cũng phát hành bản xem trước nghiên cứu của Amazon Nova Act SDK, giúp nhà phát triển dễ dàng tạo các AI Agent tự động hóa tác vụ web. SDK này hỗ trợ hoạt động trình duyệt thông qua Playwright, gọi API, tích hợp Python và xử lý luồng song song để khắc phục độ trễ tải trang. Trong các đánh giá nội bộ, Amazon Nova Act đạt điểm cao hơn 90% cho các khả năng cụ thể, ví dụ 0.939 trong ScreenSpot Web text benchmark. Những cải tiến này thể hiện cam kết của AWS trong việc không chỉ đơn giản hóa việc phát triển AI Agent mà còn đảm bảo tính mạnh mẽ, chính xác và linh hoạt của chúng trong các kịch bản thực tế.

Dữ liệu cũng "Hiểu" AI Agent: Vai trò của Amazon S3 Vectors?

Để tăng cường khả năng của AI Agent vượt ra ngoài các API truyền thống, hãy khám phá các công cụ như Amazon Nova Act. Nó cho phép tác nhân thực hiện nhiệm vụ trực tiếp trong trình duyệt web, mở rộng đáng kể phạm vi ứng dụng tự động hóa.

Trong bối cảnh AI Agent ngày càng phát triển, dữ liệu, đặc biệt là dữ liệu vector, đóng vai trò then chốt. Vector là “ngôn ngữ” của AI, biến văn bản, hình ảnh thành định dạng số mà các mô hình lớn có thể hiểu. AI Agent sử dụng vector để xây dựng ngữ cảnh từ các tương tác trong quá khứ và tìm kiếm sự tương đồng trong các tập dữ liệu khổng lồ. Nhận thấy thách thức về quy mô dữ liệu ngày càng lớn, AWS đã giới thiệu Amazon S3 Vectors – dịch vụ lưu trữ đối tượng đám mây đầu tiên hỗ trợ lưu trữ các tập dữ liệu vector quy mô lớn với hiệu suất truy vấn dưới giây.

Điểm nổi bật nhất của S3 Vectors là khả năng giảm tổng chi phí lưu trữ và truy vấn vector lên đến 90%.

Về mặt kỹ thuật, S3 Vectors giới thiệu một loại lưu trữ mới gọi là “thùng vector” (vector buckets) với giao diện API chuyên biệt để lưu trữ, truy cập và truy vấn dữ liệu vector mà không cần tự xây dựng cơ sở hạ tầng. Khi tạo một thùng vector S3, dữ liệu vector được tổ chức trong “chỉ mục vector” (vector index), giúp việc tìm kiếm sự tương đồng trở nên đơn giản. Mỗi thùng vector có thể chứa tới 10.000 chỉ mục vector, mỗi chỉ mục có thể lưu trữ hàng chục triệu vector.

Khi thêm dữ liệu vector vào chỉ mục, người dùng có thể đính kèm siêu dữ liệu (dưới dạng cặp khóa-giá trị), cho phép lọc theo các điều kiện cụ thể khi truy vấn (ví dụ: theo ngày, danh mục hoặc sở thích người dùng). S3 Vectors tự động tối ưu hóa dữ liệu vector khi người dùng ghi, cập nhật và xóa, đảm bảo tỷ lệ hiệu suất/chi phí tối ưu cho lưu trữ vector, ngay cả khi quy mô dữ liệu tăng lên.

S3 Vectors cũng tích hợp nguyên bản với Amazon Bedrock Knowledge Bases (bao gồm Amazon SageMaker Unified Studio) để xây dựng các ứng dụng tạo sinh tăng cường truy xuất (RAG) hiệu quả về chi phí. Việc tích hợp với Amazon OpenSearch Service cho phép chuyển các vector ít truy vấn vào S3 Vectors để giảm chi phí lưu trữ, sau đó nhanh chóng chuyển chúng sang OpenSearch khi nhu cầu tăng lên, hoặc để hỗ trợ các hoạt động tìm kiếm thời gian thực, độ trễ thấp.

Động thái này của AWS đặt nền móng vững chắc cho việc quản lý dữ liệu cho các ứng dụng AI Agent quy mô lớn, giải quyết một trong những nút thắt quan trọng nhất trong việc triển khai RAG hiệu quả và tiết kiệm chi phí.

Kiro: Cách AI Agent thay đổi lập trình?

Dữ liệu vector là nền tảng cho AI Agent, đóng vai trò quan trọng trong việc xây dựng ngữ cảnh và tìm kiếm sự tương đồng. Các dịch vụ như Amazon S3 Vectors giải quyết bài toán lưu trữ và truy vấn dữ liệu vector quy mô lớn một cách hiệu quả về chi phí và hiệu suất.

Ngoài cơ sở hạ tầng và mô hình, AWS còn giới thiệu một công cụ lập trình AI miễn phí hoàn toàn mới mang tên Kiro. Nếu tóm tắt điểm nổi bật của Kiro bằng một câu, đó là: chỉ cần có ý tưởng, Kiro có thể giúp bạn biến ý tưởng đó thành phần mềm thực tế, với sự tham gia sâu sắc của các tác nhân AI chuyên nghiệp từ khởi tạo dự án, thiết kế, lập trình đến bảo trì cuối cùng.

Hãy xem xét ví dụ về việc thêm một hệ thống bình luận cho trang web thương mại điện tử, Kiro thực hiện chỉ trong ba bước:

-

Biến yêu cầu một câu thành kế hoạch chi tiết:

- Yêu cầu: “Thêm hệ thống bình luận cho sản phẩm.”

- Kiro ngay lập tức hiểu ý định và phân tích yêu cầu đơn giản này thành các kịch bản người dùng và yêu cầu cụ thể, như “người dùng có thể xem bình luận,” “người dùng có thể viết bình luận,” “người dùng có thể lọc bình luận,” “người dùng có thể đánh giá bình luận,” v.v. Kiro còn viết rõ ràng các tiêu chí chấp nhận cho từng yêu cầu, giống như một tài liệu yêu cầu chi tiết, tránh hiểu lầm sau này.

-

Tự động tạo “bản vẽ thi công” dựa trên kế hoạch:

- Sau khi xác nhận kế hoạch, Kiro tự động nghiên cứu mã dự án hiện có và tạo ra một “bản vẽ thi công” kỹ thuật chuyên nghiệp. Bản vẽ này bao gồm cách dữ liệu sẽ luân chuyển, những giao diện dữ liệu mới cần thiết và thiết kế cơ sở dữ liệu, chẳng hạn như thiết kế chi tiết thông tin cần có trong một “bình luận” (nội dung, đánh giá, ID người dùng).

-

Biến “bản vẽ” thành các “nhiệm vụ thi công” cụ thể:

- Kiro chia toàn bộ công việc phát triển thành các nhiệm vụ nhỏ, sắp xếp theo thứ tự phụ thuộc (“làm gì trước, làm gì sau”). Mỗi nhiệm vụ được mô tả rất cụ thể, như “viết kiểm thử đơn vị,” “thực hiện kiểm thử tích hợp,” “xem xét trạng thái trang khi tải,” “thích ứng với phiên bản di động,” “đảm bảo khả năng tiếp cận,” v.v.

Khác biệt cốt lõi của Kiro so với các công cụ lập trình AI khác là nó đã tiêu chuẩn hóa quy trình làm việc của lập trình AI. Kiro không chỉ tạo mã mà còn quản lý toàn bộ chu trình phát triển phần mềm bằng cách sử dụng các tác nhân AI, biến nó thành một công cụ thay đổi cuộc chơi cho các nhà phát triển. Điều này thể hiện một sự thay đổi mô hình trong phát triển phần mềm, dân chủ hóa lập trình AI phức tạp và tăng cường đáng kể năng suất của nhà phát triển bằng cách nhúng các tác nhân thông minh vào toàn bộ vòng đời.

Vì sao AI Agent lại là "Nước cờ lớn" của AWS?

Đừng bỏ qua các công cụ lập trình AI mới như Kiro. Công cụ này hứa hẹn cách mạng hóa quy trình phát triển phần mềm bằng cách sử dụng các tác nhân AI để tự động hóa từ khâu lên ý tưởng đến bảo trì, giúp tăng năng suất đáng kể cho nhà phát triển.

Tất cả những công bố mới nhất từ AWS, từ AgentCore, S3 Vectors đến Kiro, đều xoay quanh một chủ đề duy nhất: AI Agent. Điều này không phải ngẫu nhiên mà là một phần của “nước cờ lớn” từ gã khổng lồ điện toán đám mây.

Như Swami Sivasubramanian đã tuyên bố, mục tiêu của AWS là “trở thành nơi tốt nhất để xây dựng các AI Agent hữu ích nhất thế giới.” Trong tầm nhìn của AWS, AI Agent không chỉ là một khái niệm công nghệ mà còn là công cụ để các doanh nghiệp nâng cao hiệu quả hoạt động. Bằng cách sử dụng AI Agentic, các công ty có thể giao phó các nhiệm vụ lặp đi lặp lại, có logic rõ ràng cho các tác nhân thông minh, giúp nhân viên tập trung vào những công việc sáng tạo và chiến lược hơn.

Sự tập trung của AWS vào AI Agent còn được củng cố bởi các xu hướng thị trường rõ ràng. Các doanh nghiệp đang ngày càng ưu tiên các chức năng AI Agentic có khả năng truy vấn nhiều mô hình cụ thể theo nhiệm vụ, thay vì chỉ một mô hình nền tảng duy nhất. Phương pháp tiếp cận đa mô hình này mang lại khả năng mở rộng mạnh mẽ hơn trên nhiều lĩnh vực. Matt Garman, CEO của AWS, đã khẳng định: “AI Agent sẽ thay đổi cách tất cả chúng ta làm việc và sinh sống, tác động của nó có thể so sánh với sự ra đời của internet.”

Sự “đổ bộ” toàn diện vào AI Agent của AWS, từ cơ sở hạ tầng, khung mô hình đến ứng dụng, không chỉ phản ánh một xu hướng công nghệ không thể đảo ngược mà còn cho thấy một chiến lược được tính toán kỹ lưỡng. AWS đang đặt mình vào vị trí tiên phong, không chỉ cung cấp các khối xây dựng mà còn kiến tạo một “phạm thức mới” cho việc triển khai AI Agent vào sản xuất một cách “nhanh chóng, hiệu quả và tiết kiệm”. Điều này định hình lại kỳ vọng của thị trường về khả năng của các tác nhân AI và cách chúng sẽ được tích hợp vào hoạt động kinh doanh hàng ngày.

Tips AI Tech sẽ tiếp tục theo dõi và cập nhật những diễn biến mới nhất về chủ đề này.

Việc AWS đổ bộ toàn diện vào AI Agent cho thấy đây là một “nước cờ lớn” định hình tương lai. Điều này có nghĩa là thị trường sẽ ngày càng kỳ vọng vào các tác nhân AI có khả năng mạnh mẽ, chính xác và linh hoạt, tích hợp sâu hơn vào hoạt động kinh doanh hàng ngày.

Các câu hỏi thường gặp (FAQ)